Im Jahr 2025 hat sich Deepfake-Betrug von einer theoretischen Bedrohung zu einem messbaren Geschäftsrisiko entwickelt. KI-generierte Stimmen und Videos erreichen eine Qualität, die selbst geschulte Beobachter täuschen kann. Die Angriffsvektoren reichen von gefälschten CEO-Videoanrufen über manipulierte Bewerbungsgespräche bis hin zu synthetischen Identitäten in Finanztransaktionen. Was diese neue Bedrohungsklasse besonders gefährlich macht, ist ihre Wirkung auf einer Ebene, die herkömmliche IT-Sicherheit nicht adressiert: die menschliche Wahrnehmung.

Die neurokognitive Schwachstelle

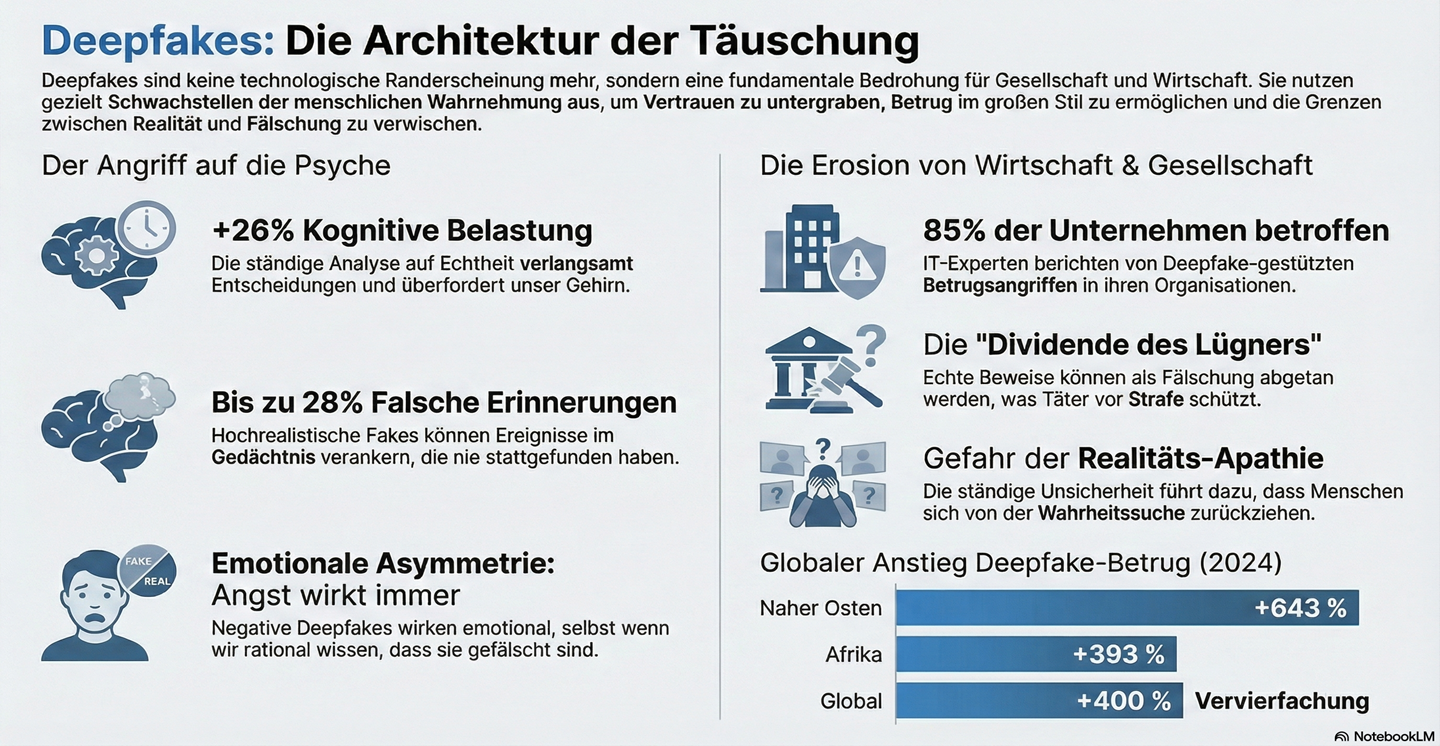

Menschen sind evolutionär darauf programmiert, Gesichter zu erkennen und Stimmen zu vertrauen. Diese tief verankerten neuronalen Muster bilden die Grundlage sozialer Interaktion und lassen sich nicht einfach abtrainieren. Deepfakes nutzen genau diese Schwachstelle aus: Wenn ein Mitarbeiter das Gesicht und die Stimme seines Vorgesetzten in einem Videocall sieht und hört, schaltet das analytische Denken in den Hintergrund. Der emotionale Vertrauenskredit, den Gesicht und Stimme auslösen, übertrifft rationale Plausibilitätsprüfungen. Klassische Phishing-Schulungen, die auf das Erkennen verdächtiger E-Mails abzielen, greifen hier zu kurz.

Phishing 3.0 und der Liar's Dividend

Deepfake-gestützter Betrug bildet die dritte Generation des Phishings: Nach E-Mail-basiertem Phishing (1.0) und Spear-Phishing mit Social Engineering (2.0) kommt nun die Simulation realer Personen in Echtzeit. Parallel entsteht ein zweiter Schadenskanal: der sogenannte Liar's Dividend. In einer Welt, in der jedes Video und jede Stimme gefälscht sein könnte, können echte Aussagen als Fälschung abgetan werden. Dieser Vertrauensverlust trifft nicht nur die Cybersicherheit, sondern untergräbt die epistemische Grundlage von Kommunikation insgesamt – in Unternehmen, Medien und öffentlichem Diskurs.

Die Human Firewall als Verteidigungslinie

Technische Erkennungssysteme für Deepfakes existieren, aber sie befinden sich in einem permanenten Wettlauf mit der Generierungstechnologie. Die nachhaltigere Verteidigung liegt in einer Kombination aus technischen Authentifizierungsprotokollen und menschlicher Wachsamkeit. Das Konzept der Human Firewall erweitert herkömmliche Security-Awareness um spezifische Deepfake-Szenarien: Callback-Verfahren für ungewöhnliche Anweisungen, Multi-Kanal-Verifizierung bei Finanztransaktionen und eine Unternehmenskultur, in der Rückfragen keine Illoyalität signalisieren. Die epistemische Krise lässt sich nicht allein mit Software lösen – sie erfordert organisatorische Resilienz.