Management Summary

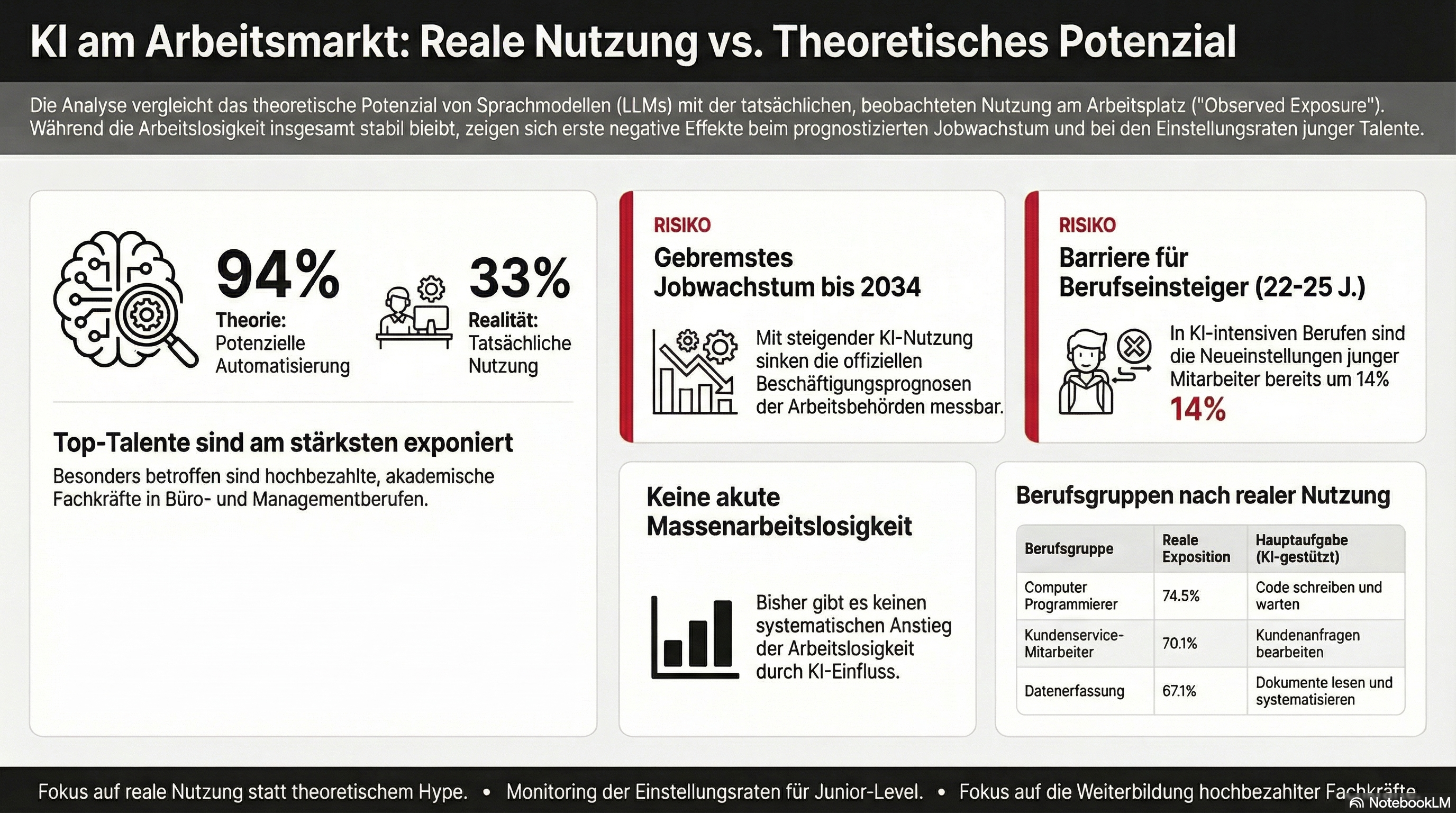

Die viel beschworene Kündigungswelle durch generative KI bleibt aus. Massenkoff und McCrory [1] zeigen mit dem Konzept der „beobachteten Exposition“ auf Basis des Anthropic Economic Index [3]: Die theoretische Substituierbarkeit von Wissensarbeit (94 Prozent in „Computer & Math“ nach Eloundou et al. [2]) wird in der Praxis nur zu 33 Prozent realisiert. Die Disruption verläuft entlang der Generationengrenze: Bestandsbelegschaften bleiben durch das O-Ring-Modell und Labour Hoarding geschützt, während Berufseinsteiger (22–25 Jahre) in exponierten Berufen seit 2024 rund 14 Prozent weniger eingestellt werden. KI eliminiert Jobs nicht direkt, sondern verschließt still die Einstiegskanäle.

Für wen relevant?

Personalvorstände und Arbeitsmarktökonomen; HR-Leitung in wissensintensiven Branchen (IT, Beratung, Recht, Finanzen, Healthcare); Bildungspolitik und Hochschulleitungen; Arbeitsmarktforscher; Führungskräfte mit Verantwortung für Junior-Programme.

Drei Kernaussagen

- Theoretische Exposition überzeichnet die Realität um den Faktor 2–3. Die Differenz zwischen Eloundou-Feasibility [2] und beobachteter Nutzung [1] ist die Hype-Korrektur, die in jeder Strategieplanung stehen sollte.

- Die wahre Frontlinie ist die Einstiegslücke. Nicht Entlassungen, sondern ausbleibende Junior-Einstellungen prägen die KI-Disruption – mit Risiko einer dauerhaften strukturellen Einstiegsbarriere.

- BLS-Prognosen [5] reflektieren bereits die reale Adoption. Pro 10 Prozentpunkte mehr beobachtete Exposition sinkt die prognostizierte Wachstumsrate eines Berufs um 0,6 Prozentpunkte – theoretische Metriken hingegen korrelieren kaum.

Die ökonomische Fachwelt steht vor der Herausforderung, den tatsächlichen Impact künstlicher Intelligenz auf den Arbeitsmarkt jenseits spekulativer Narrative zu quantifizieren. Das wegweisende Papier von Massenkoff und McCrory (2026) [1] adressiert diese Forschungslücke mit dem Konzept der „beobachteten Exposition“ (observed exposure) – einem empirisch fundierten Maß, das die theoretische Machbarkeit von Large Language Models mit realen Nutzungsdaten konfrontiert. Angesichts der historischen Demut, die wir gegenüber früheren, oft überschätzten Prognosen zur Offshorability von Dienstleistungen oder dem Verdrängungspotenzial von Industrierobotern walten lassen müssen, bietet dieser neue Messansatz eine notwendige methodische Korrektur. Durch die systematische Verknüpfung von Aufgabenprofilen mit tatsächlichem Traffic auf KI-Plattformen gelingt es den Autoren, ein präzises Frühwarnsystem zu etablieren, das über die bisherige, oft vage Kausalinferenz hinausgeht.

Die Kluft zwischen Theorie und Praxis: „Beobachtete Exposition“ als neues Maß

In der ökonomischen Literatur hat sich seit der Studie von Eloundou et al. (2023) [2] ein Standard zur Messung der theoretischen KI-Exposition etabliert. Dieser basiert auf dem Skalenwert β, der quantifiziert, ob eine spezifische Aufgabe durch ein LLM um mindestens 50 Prozent beschleunigt werden kann. Ein β-Wert von 1 signalisiert die volle theoretische Substituierbarkeit durch das Modell allein, während 0,5 den Einsatz spezialisierter Tools voraussetzt. Massenkoff und McCrory konfrontieren diese theoretische Landkarte nun mit dem Anthropic Economic Index [3], der auf Millionen realer Interaktionen mit dem Modell Claude basiert.

Die Ergebnisse sind ernüchternd für jene, die eine unmittelbare Automatisierungswelle prophezeiten. Die theoretische Abdeckung in Kategorien wie „Computer & Math“ erreicht einen Wert von 94 Prozent. Im krassen Gegensatz dazu steht die tatsächlich beobachtete Nutzung, die im selben Sektor lediglich bei 33 Prozent verharrt. In anderen hochqualifizierten Bereichen wie „Legal“ oder „Business & Finance“ ist das Bild ähnlich: Die theoretische Potenz übersteigt die praktische Umsetzung um das Zwei- bis Dreifache.

Warum bleibt die tatsächliche Abdeckung so weit hinter dem Feasibility-Horizont zurück? Die Autoren identifizieren mehrere fundamentale Diffusionsbarrieren. Erstens existieren rechtliche und regulatorische Hürden, etwa im Gesundheitswesen oder bei juristischen Dienstleistungen, die einen Human-in-the-loop zwingend vorschreiben. Zweitens erfordert die Integration von LLMs in bestehende Unternehmenssoftware oft komplexe API-Implementierungen, die weit über das Chat-Interface hinausgehen. Drittens müssen organisatorische Anpassungsprozesse durchlaufen werden: Das bloße Vorhandensein einer Technologie bedeutet nicht deren produktiven Einsatz.

Methodisch ist die Gewichtung entscheidend. Das Framework zählt eine Aufgabe nur dann als exponiert, wenn sie im Anthropic Economic Index signifikante, arbeitsrelevante Nutzungsmuster zeigt. Automatisierte Anwendungen über API-Schnittstellen werden voll gewichtet, rein augmentative Nutzungen nur mit dem Faktor 0,5. Die extrem hohe Spearman-Korrelation zwischen theoretischen Vorhersagen und tatsächlicher Nutzung bestätigt die Validität: Aufgaben mit einem β-Wert von 1 machen 68 Prozent des gesamten Claude-Traffics aus. Aufgaben ohne theoretisches Potenzial erreichen hingegen lediglich drei Prozent. Die Technologie wird punktgenau dort eingesetzt, wo sie theoretisch glänzen kann – doch die letzte Meile der Implementierung erweist sich als zäher als erwartet.

Dabei darf nicht übersehen werden, dass der Anthropic Economic Index einer gewissen Selektionsverzerrung unterliegen könnte, da er primär die Nutzerschaft von Claude widerspiegelt. Die beobachtete Exposition ist somit als Untergrenze der tatsächlichen Verbreitung zu verstehen, da alternative Modelle und firmeninterne Closed-Source-Lösungen nicht erfasst werden. Dennoch bietet sie das derzeit präziseste Korrektiv zu rein hypothetischen Modellen.

Das neue Gesicht der Verwundbarkeit: Wer wirklich exponiert ist

Die Dekonstruktion der demografischen Daten offenbart eine Zäsur in der Geschichte der Automatisierung. Während frühere Schöcke – der China-Schock oder die Einführung von Schweißrobotern – primär männliche Blue-Collar-Arbeiter mit mittlerem Bildungsabschluss trafen, ist die KI-Exposition ein Phänomen der kognitiven Elite.

Die Analyse der Unterschiede zwischen der am stärksten exponierten Gruppe und der Gruppe ohne Exposition zeichnet ein klares Bild:

Geschlecht: Exponierte Arbeiter sind mit einer Wahrscheinlichkeit von +15,5 Prozentpunkten eher weiblich. Dies liegt an der hohen Repräsentanz von Frauen in administrativen, koordinierenden und textbasierten Berufen, die besonders empfänglich für LLM-Unterstützung sind.

Bildungsgrad: Hier zeigt sich die dramatischste Verschiebung. Während in der unexponierten Gruppe nur 4,5 Prozent über einen Master-Abschluss oder höher verfügen, sind es in der exponierten Gruppe 17,4 Prozent – fast die vierfache Rate. KI greift nicht am unteren Ende der Qualifikationsleiter an, sondern im Herzen der Wissensgesellschaft.

Einkommensstruktur: Die finanzielle Differenz ist signifikant. Exponierte Arbeitskräfte verdienen im Durchschnitt 32,69 Dollar pro Stunde, während ihre unexponierten Kollegen bei 22,23 Dollar liegen – ein Unterschied von rund 47 Prozent. Die Technologie adressiert Aufgaben, die bisher aufgrund ihrer Komplexität hoch vergütet wurden.

Interessanterweise sind exponierte Arbeiter im Durchschnitt auch älter und seltener gewerkschaftlich organisiert. Diese demografische Konstellation deutet darauf hin, dass die betroffenen Personen über eine hohe individuelle Verhandlungsmacht verfügen könnten, aber gleichzeitig durch den Wegfall kollektivvertraglicher Schutzmechanismen im Falle einer echten Disruption anfälliger für eine White-Collar Wage Compression sind. Wo früher die körperliche Kraft oder das handwerkliche Geschick vor Automatisierung schützten, bot in den letzten Jahrzehnten die formale Bildung diesen Schutz. Dieses Schutzschild bekommt nun Risse.

Das Paradoxon der Arbeitslosigkeit: Exposition führt (noch) nicht zu Entlassungen

Trotz der hohen Exposition in gut bezahlten Berufen lässt sich bis heute – mehr als drei Jahre nach dem breiten Roll-out generativer KI – kein systematischer Anstieg der Arbeitslosigkeit in den betroffenen Sektoren nachweisen. Massenkoff und McCrory nutzen hierfür einen robusten Differenz-von-Differenzen-Ansatz, um die Trends vor und nach dem Release von ChatGPT Ende 2022 zu vergleichen.

Die Daten zeigen: Während der COVID-19-Pandemie 2020 explodierte die Arbeitslosigkeit bei den unexponierten Arbeitern – oft im Gastgewerbe oder im persönlichen Service ohne Homeoffice-Option – massiv, während die exponierte Gruppe stabil blieb. Seit Ende 2022 verlaufen die Linien für beide Gruppen jedoch fast perfekt parallel. Der Differenz-von-Differenzen-Koeffizient für die Phase nach ChatGPT liegt bei lediglich +0,0020 und ist statistisch nicht signifikant.

Dieses Ausbleiben von Entlassungen lässt sich durch das ökonomische O-Ring-Modell erklären. In einer Produktionskette, die aus mehreren Aufgaben besteht, bestimmt das schwächste Glied den Gesamtwert. Solange KI nur 30 oder 50 Prozent der Aufgaben eines Programmierers oder Analysten übernimmt, aber kritische Teilaufgaben – die finale Validierung, die Einbettung in den Geschäftskontext, die rechtliche Verantwortung – weiterhin menschliche Expertise erfordern, bleibt die Arbeitskraft für den Gesamtprozess unverzichtbar. Der Job wird transformiert, nicht eliminiert.

Zudem greift das Phänomen des Labour Hoarding: In einem angespannten Arbeitsmarkt zögern Unternehmen, hochqualifiziertes Personal zu entlassen, selbst wenn kurzfristige Produktivitätsgewinne erzielt werden, da die Wiederbeschaffungskosten dieser Talente extrem hoch sind. Ein Rückgang der Stellenausschreibungen deutet daher eher auf eine Konsolidierung und eine Verringerung der Fluktuation hin als auf eine aktive Freisetzung von Personal.

Frühwarnsystem Nachwuchs: Der schleichende Einstellungsstopp

Während die Bestandsbelegschaften durch Kündigungsschutz und implizites Wissen geschützt scheinen, fungiert die Gruppe der jungen Arbeitskräfte (22–25 Jahre) als sprichwörtlicher Kanarienvogel in der Kohlemine. In dieser Kohorte finden sich die ersten statistisch belastbaren Anzeichen einer strukturellen Verschiebung.

Die Daten zeigen, dass die Neueinstellungsrate in hoch exponierten Berufen für Berufseinsteiger signifikant gesunken ist. Während die monatliche Rate der Arbeitsaufnahmen in unexponierten Sektoren stabil bei etwa zwei Prozent verharrt, zeigt die Kurve für exponierte Berufe ab Anfang 2024 eine deutliche Divergenz nach unten. Der aggregierte Rückgang beläuft sich auf circa 14 Prozent im Vergleich zum Basisjahr 2022.

Dies lässt eine strategische Zurückhaltung der Unternehmen erkennen. Junior-Positionen werden oft mit Aufgaben betraut, die einen hohen Anteil an Recherche, Datenaufbereitung oder einfachem Coding enthalten – genau jene Segmente, in denen die beobachtete Exposition am höchsten ist. Wenn ein Senior-Entwickler durch KI-Unterstützung 20 Prozent produktiver wird, sinkt der Bedarf an einem Junior-Assistenten, bevor der Senior selbst überflüssig wird.

Für die betroffenen 22- bis 25-Jährigen bedeutet dies nicht zwangsläufig sofortige Arbeitslosigkeit; viele verbleiben länger im Bildungssystem, wechseln in weniger exponierte Branchen oder akzeptieren Jobs unterhalb ihres Qualifikationsniveaus. Dennoch ist der Befund alarmierend, da er auf eine schleichende Schließung der Einstiegskanäle hindeutet. Es handelt sich primär um einen Effekt reduzierter Einstellungen, nicht erhöhter Trennungen.

Die Frontlinie der Automatisierung: Top-Berufe im Fokus

Welche Berufe befinden sich konkret unter Beschuss? Die Spitzenreiter der beobachteten Exposition sind:

Computer Programmers (74,5 %): Die führende automatisierte Aufgabe ist das Schreiben, Aktualisieren und Pflegen von Softwarecodes. Die hohe Durchdringung korrespondiert mit der intensiven Nutzung von LLMs für Programmieraufgaben.

Customer Service Representatives (70,1 %): Der Fokus liegt auf der Kommunikation mit Kunden zur Informationsvermittlung und Beschwerdebearbeitung. Hier vollzieht sich bereits eine massive Verlagerung hin zu API-gestützten, vollautomatisierten Systemen.

Data Entry Keyers (67,1 %): Das Lesen von Quelldokumenten und die systematische Erfassung von Daten ist ein klassisches Substitutionsfeld für LLMs mit hoher OCR- und Extraktionskompetenz.

Medical Record Specialists (66,7 %): Das Kompilieren und Codieren von Patientendaten zeigt eine überraschend hohe reale Nutzung, was auf eine fortgeschrittene digitale Transformation im US-Gesundheitswesen hindeutet.

Market Research Analysts (64,8 %): Die Erstellung von Ergebnisberichten und die grafische Aufbereitung komplexer Daten durch KI-Tools hat bereits tiefe Spuren in den Arbeitsprozessen hinterlassen.

Am anderen Ende des Spektrums finden sich Berufe mit einer Expositionsrate von exakt null Prozent: Köche, Motorradmechaniker, Bademeister, Spülkräfte. Die Grenze der KI ist physischer Natur – überall dort, wo taktile Präzision, physische Präsenz in einer unstrukturierten Umgebung oder die direkte Interaktion mit materiellen Objekten erforderlich ist, stoßen LLMs an ihre Grenzen. Die Disruption ist fast ausschließlich auf digitale Workflows begrenzt, was etwa 30 Prozent der US-Arbeitskräfte vorerst eine vollständige Immunität verleiht.

Validierung durch den Arbeitsmarkt: BLS-Prognosen im Abgleich

Ein zentrales Qualitätsmerkmal des Frameworks ist seine prognostische Relevanz. Der Abgleich mit den offiziellen Beschäftigungsprognosen des Bureau of Labor Statistics für 2024–2034 [5] zeigt eine statistisch signifikante negative Korrelation: Pro zehn Prozentpunkte zusätzlicher beobachteter KI-Exposition sinkt die prognostizierte Wachstumsrate eines Berufs um 0,6 Prozentpunkte. Der Regressionskoeffizient von -6,07 verdeutlicht, dass die BLS-Analysten die realen Adoptionsmuster der Technologie bereits in ihre langfristigen Schätzungen integriert haben.

Bemerkenswert ist, dass die rein theoretischen Metriken kaum eine Korrelation mit den BLS-Prognosen aufweisen. Dies unterstreicht den Wert des neuen Ansatzes: Erst die Einbeziehung der realen Nutzungsevidenz macht technologische Potenziale für die Arbeitsmarktprognostik nutzbar. Die beobachtete Exposition filtert den Hype heraus und lässt nur jene Veränderungen übrig, die tatsächlich ökonomisch wirksam werden.

Schlussbetrachtung und Synthese

Die Daten zwingen zu einer differenzierten Sichtweise. Wir erleben derzeit keine plötzliche Kündigungswelle, sondern eine tiefgreifende, aber oft geräuschlose Transformation von Arbeitsprozessen. Das Paradoxon, dass hohe Exposition nicht zu Arbeitslosigkeit führt, löst sich auf, wenn wir KI als Werkzeug zur Bewältigung komplexer Aufgaben verstehen, das die menschliche Arbeitskraft ergänzt, solange kritische O-Ring-Aufgaben bestehen bleiben.

Die wahre Frontlinie verläuft jedoch entlang der Generationengrenze. Der beobachtete Einstellungsstopp bei Berufseinsteigern deutet darauf hin, dass die Disruption nicht durch den Rauswurf der Etablierten, sondern durch die Nicht-Aufnahme der Neuen erfolgt. Dies birgt das Risiko einer dauerhaften strukturellen Barriere für junge Talente, die ihre traditionellen Einstiegsrollen an Algorithmen verlieren.

Abschließend stellt sich die präzise Fachfrage: Wird diese Verlangsamung der Neueinstellungen bei Berufseinsteigern zu einer dauerhaften strukturellen Barriere führen, die eine neue Form der Diploma Inflation auslöst – oder werden wir lediglich eine qualitative Verschiebung der Einstiegskompetenzen erleben, bei der die Beherrschung von KI-Tools zur absoluten Basisanforderung wird? Die Antwort auf diese Frage wird die Verteilungskämpfe am Arbeitsmarkt des nächsten Jahrzehnts definieren.

Quellen

Primärstudien und Statistik. Abruf: 27.04.2026.

- Massenkoff, Maxim & McCrory, Peter: Labor market impacts of AI: A new measure and early evidence. Anthropic Research, 2026. anthropic.com

- Eloundou, T.; Manning, S.; Mishkin, P.; Rock, D.: GPTs are GPTs: An Early Look at the Labor Market Impact Potential of Large Language Models. arXiv:2303.10130, 2023; veröffentlicht in Science (2024). arxiv.org

- Anthropic: Anthropic Economic Index – Learning Curves. März 2026. anthropic.com

- U.S. Department of Labor / O*NET OnLine: Occupational Information Network – Berufstaxonomie. onetonline.org

- U.S. Bureau of Labor Statistics: Employment Projections 2024–2034. bls.gov

🎧 Diesen Beitrag als Podcast hören

Die Kernthesen dieses Artikels gibt es auch als Podcast-Episode: KI trifft eher Akademiker als Mechaniker

Weiterlesen

Analysen wie diese in den Posteingang?

Der Newsletter bündelt die wichtigsten Beiträge des Monats. Kein Spam, kein Tracking.

Newsletter abonnieren